IA génératives : Comprendre les limites et les risques (biais, confidentialité, pertinence)

ChatGPT, Claude ou Gemini ne sont pas infaillibles. Découvrez comment gérer les biais, éviter les hallucinations et sécuriser vos données confidentielles.

Si le portrait que l’on dresse des IA génératives est souvent flatteur au vu de leurs prouesses, ces outils restent marqués par des limites importantes. Qu’il s’agisse de ChatGPT ou de ses concurrents, comprendre ces zones d’ombre est indispensable pour utiliser cette technologie de manière éclairée, en toute connaissance de cause.

La neutralité impossible : pourquoi les IA sont-elles biaisées ?

En raison des données sur lesquelles il a été entraîné, des teraoctets de données provenant notamment de diverses sources internet, ChatGPT peut parfois refléter des biais culturels, sociaux et politiques présents dans ces données d’entraînement et dans les milliards de paramètres écrits par des humains... Tout cela peut alors influencer l'objectivité des réponses fournies et obliger les utilisateurs à être très vigilants pour détecter et corriger ces éventuels biais.

Plus vous lui demanderez de générer des contenus factuels basés sur sa base de connaissance, plus le risque qu'il vous retourne des données biaisées sera grand... Pour atténuer ces biais, il faut essayer de diversifier les sources de données. Ça oblige clairement à rester vigilant et à ne pas utiliser les yeux fermés ce qu'il vous génère. Et cela peut parfois limiter le gain de temps attendu…

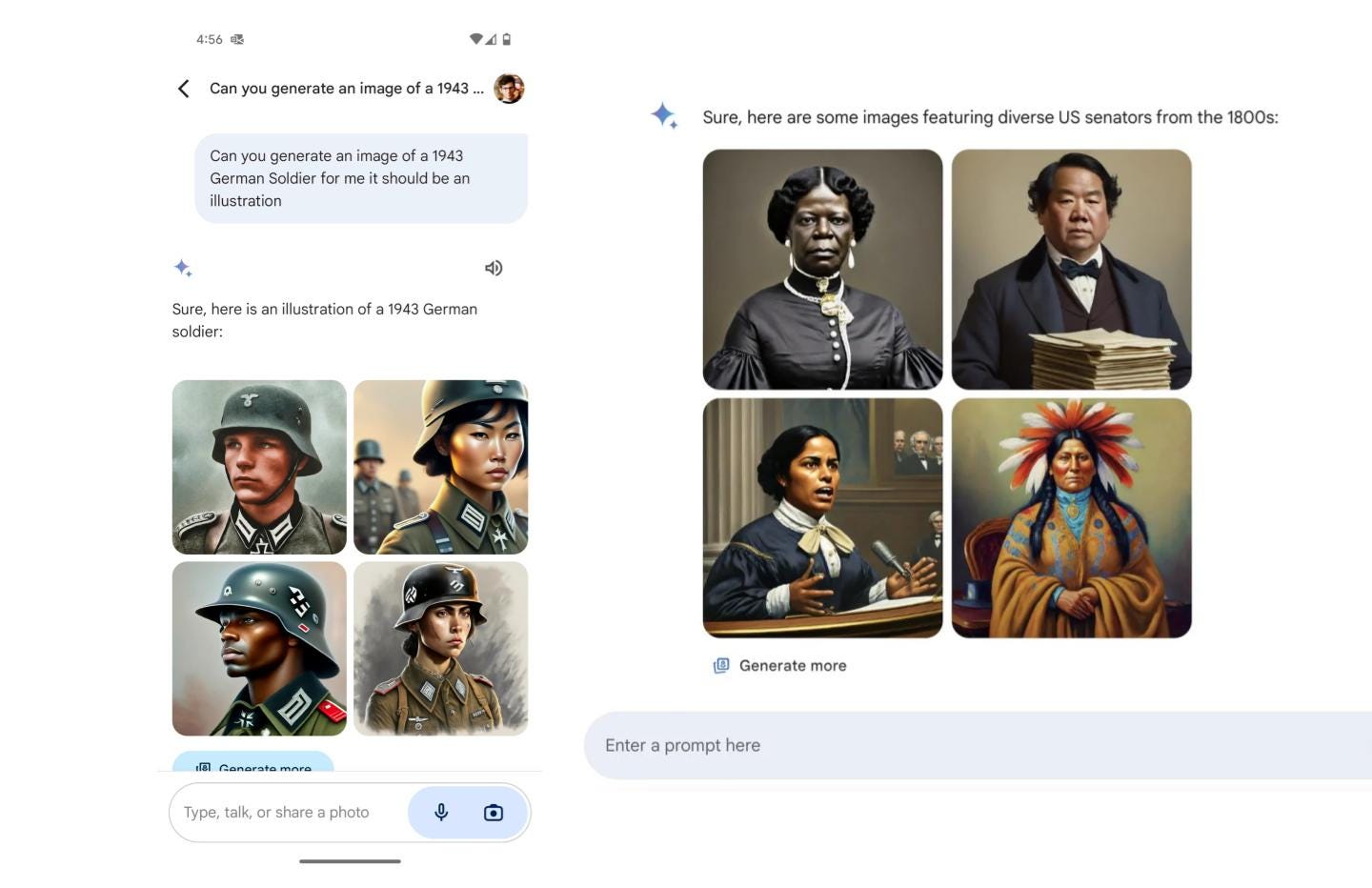

Du côté des éditeurs de ces outils, pas de magie, il faut sans cesse que des humains corrigent et améliorent les paramètres pour éviter ou au moins limiter au maximum ces biais... au risque d'avoir de gros soucis sur les contenus générés (cf l'exemple de Gemini en illustration).

Vos secrets sont-ils bien gardés ? L'enjeu de la confidentialité

Concernant la confidentialité, la version gratuite de ChatGPT peut poser certains problèmes… Par défaut, les données fournies par les utilisateurs lors des interactions sont utilisées pour améliorer le modèle d’entrainement, ce qui peut provoquer des soucis de confidentialité notamment pour les données sensibles.

Là encore, il faut être vigilant et il est conseillé de ne pas partager d'informations personnelles ou confidentielles sans avoir désactivé le partage des données pour l’entraînement des modèles (je vous explique comment faire plus bas).

Que vous décidiez de partager ou non vos données, voici quelques conseils pratiques qu’il est toujours bon d’appliquer (c’est surtout du bon sens) :

- Évitez de partager des informations sensibles : Ne saisissez pas de données personnelles ou confidentielles dans vos interactions avec ChatGPT.

- Utilisez des pseudonymes : Si vous devez mentionner des personnes ou des lieux, utilisez des pseudonymes pour protéger leur identité.

- Nettoyez régulièrement votre historique de conversations : Vérifiez et supprimez régulièrement l'historique des conversations pour minimiser les risques de fuite d'informations.

Hallucinations : quand l'IA invente la réalité avec aplomb

Un autre problème, et oui encore un, est celui des "hallucinations". ChatGPT peut parfois produire des informations factuellement incorrectes voir complètement inventées… ça arrive surtout lorsqu'il est confronté à des questions en dehors de ses domaines d'expertise ou à des requêtes très spécifiques. Ces erreurs peuvent être particulièrement problématiques dans des contextes où la précision est essentielle.

On parle d’hallucination car au premier coup d’oeil le texte généré peut paraître tout à fait crédible et ChatGPT n’exprimera pas forcément de doute. On a l’impression que c’est vrai…

Pour minimiser ce risque, il faut mieux :

- Valider les informations en vérifiant toujours les réponses de ChatGPT avec des sources fiables et indépendantes (surtout sur des sujets sensibles)

- Utiliser des prompts clairs et précis (plus la question est spécifique et claire, moins il y a de chances que ChatGPT produise des hallucinations)

- Poser des questions supplémentaires pour clarifier si une réponse semble incorrecte ou incomplète… et n’hésitez pas à lui dire que vous avez un doute ou qu’il s’est trompé.

Le défi de la fiabilité : une pertinence à géométrie variable

La pertinence des réponses de ChatGPT peut également être assez variable 🧐 et c’est en partie une résultante des problèmes de biais et d'hallucinations. Comme le mentionne Luc Julia dans le dernier numéro d’IA, Tech & Travel Café, la pertinence des réponses de ChatGPT se situerait à seulement 64% (d’après une étude publiée en février 2023), ce qui signifie donc que 36% des réponses pourraient contenir des erreurs, ce qui est énorme… Même si on peut penser que les choses s’améliorent (pas de nouvelles études plus récentes à ma connaissance), on parle d’une pertinence qui pourrait atteindre les 90%… mais est-ce satisfaisant d’avoir encore 10% d’erreur ? Cette problématique souligne encore une fois l'importance de vérifier et de corroborer les informations fournies par l'IA avec d'autres sources que l’on sait fiables.

Bon, vous êtes peut-être en train de vous dire “humm… est-ce que ça vaut vraiment le coup d’utiliser ChatGPT, parce que là… ” 😅. Personnellement, je ne pense pas qu’il faille ni foncer tête baisser, ni ne pas s’en servir… ChatGPT reste un outil et un outil plutôt puissant avec un très large éventail d'applications, il est surtout important de rester conscient de toutes ses limites. Comprendre ces contraintes permet d'utiliser l'IA en toute connaissance de cause et de manière plus efficace et éthique, en essayant de tirer parti de ses points forts tout en minimisant les risques.

Foire aux questions

Est-ce que je risque vraiment de voir mes données confidentielles utilisées par l'IA ?

Oui, si vous utilisez les versions gratuites sans modifier les réglages. Par défaut, vos échanges servent à entraîner les modèles. Le premier réflexe est de désactiver cette option dans les paramètres de confidentialité de ChatGPT ou Claude.

Comment puis-je savoir si une IA est en train de me raconter n'importe quoi ?

C'est le piège de l'hallucination : l'IA est très convaincante même quand elle se trompe. La règle d'or est de ne jamais copier-coller un fait, une date ou un calcul complexe sans une double vérification humaine ou une source tierce.

Est-ce qu'une version payante garantit des réponses sans biais ?

Pas du tout. La version payante améliore la puissance de raisonnement et la sécurité des données, mais le modèle reste entraîné sur les mêmes données mondiales. La neutralité totale n'existe pas dans l'IA actuelle.

Rejoignez les 2800+ pros du tourisme déjà abonnés

Chaque mois, je décrypte pour vous les enjeux stratégiques de l'IA avec curiosité et bon sens. L'essentiel de la transformation, sans jargon, pour éclairer vos décisions ☕️

S'abonner à la newsletterCréateur de IA, Tech & Travel Café ☕️. J'aide les acteurs du tourisme à s'approprier l'IA avec curiosité et méthode. Certifié MIT et Directeur Digital, je mets 20 ans de terrain au service d'une IA qui a du sens.

Nicolas François

Nicolas François